Hi AInauten,

Willkommen zum 🔒 Deep-Dive 🔒 für diese Woche.

Mal ehrlich: Hast du auch schon mal AI-generierte Zahlen in ein wichtiges Reporting gepackt?

Letzte Woche saßen wir mit einem Geschäftsführer zusammen. Mittelständisches Unternehmen, 100 Mitarbeiter, hochmotiviertes Team.

Die haben seit einem Jahr Claude und ChatGPT im Einsatz und sie sind begeistert. Reportings, die früher Tage gebraucht haben, sind in Stunden fertig. Research-Aufgaben dauern Minuten statt Stunden.

Alles super, oder?

Bis ihm auffiel, dass in den letzten drei Monatsreportings ans Management systematisch falsche Zahlen standen! Nicht dramatisch falsch, aber falsch genug, um strategische Entscheidungen zu verfälschen.

Der Schuldige? Ein gut gemeintes, aber schlecht überwachtes AI-Setup. Die Maschine hatte Zahlen "halluziniert", Prozentsätze falsch berechnet, Datenquellen verwechselt. Und niemand hatte es gemerkt, weil die Outputs so verdammt professionell aussahen.

Das Problem: Sie hatten AI produktiv gemacht – aber nicht sicher.

Und genau da setzen die meisten von uns an.

Wir lernen Prompting, bauen Kontext, optimieren unsere Workflows, entdecken neue Tools. Aber wir überspringen die Basis:

Wie arbeiten wir eigentlich sicher und verantwortungsvoll mit AI?

Welche Aufgaben können wir wirklich delegieren? Wo müssen wir eingreifen?

Und wie zum Teufel überprüfen wir, ob das Ergebnis stimmt – ohne jedes Mal alles manuell nachzuprüfen (was ja den ganzen Effizienz-Gewinn zunichtemachen würde)?

Wir sehen das ständig in unserer Community: Fortgeschrittene AI-Nutzer, die technisch alles draufhaben – aber bei den fundamentalen Fragen ins Straucheln geraten.

Was du in diesem Deep-Dive lernst

Dieser Post ist etwas anders als unsere üblichen Praxis-Guides. Du bekommst ein strategisches Framework, das seit 2.5 Jahren Bestand hat und auch in Zukunft Bestand haben wird, egal wie die Modelle sich entwickeln.

Das 4V-Framework (in der Basis entwickelt von Anthropic und von uns für die Praxis adaptiert) gibt dir ein mentales Modell für professionelle AI-Nutzung.

Du lernst:

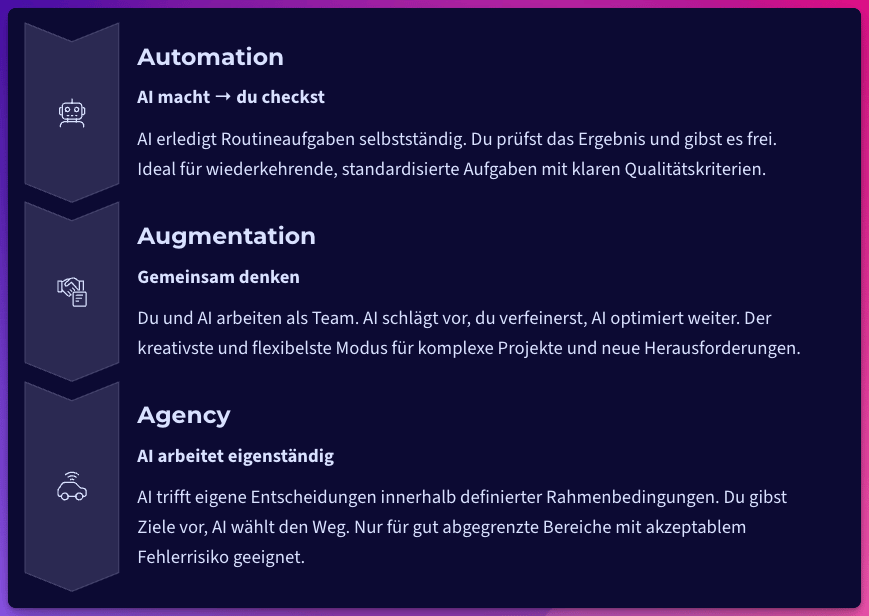

Die drei Modi der AI-Zusammenarbeit – und warum du für jeden einen anderen Sicherheitsansatz brauchst

Das 4V-Framework – Verteilen, Vermitteln, Verifizieren, Verantworten als tägliche Checkliste

Praktische Entscheidungshilfen – welche Aufgaben du delegieren kannst (und welche nicht)

Verifikations-Strategien – wie du Halluzinationen erkennst, ohne alles manuell zu prüfen

Datenschutz & Ethik – was du hochladen darfst und was nicht

Reality Check – wo die Grenzen liegen und wie du damit umgehst

Das ist kein theoretisches Gedankenspiel. Dieses Framework macht deine tägliche AI-Nutzung besser, sicherer und effizienter. Versprochen.

Zeitinvestition: 15–18 Minuten Lesezeit für Jahre an sicherer AI-Nutzung.

So ist der Post aufgebaut:

Die drei Modi der AI-Zusammenarbeit

Das 4V-Framework im Detail – die vier Säulen professioneller AI-Nutzung

Reality Check – wo das Framework an seine Grenzen stößt

Dein Aktionsplan – konkrete Schritte für die nächsten 7 Tage

P.S. Dieser Post ist ohne Video. Aber wir werden bald ein komplettes Training zum Thema veröffentlichen. Stay Tuned!

Teil 1: Die drei Modi der AI-Zusammenarbeit – mehr als nur „Chat with AI"

Bevor wir ins 4V-Framework einsteigen, müssen wir verstehen: Es gibt nicht die eine Art, mit AI zu arbeiten.

Je nachdem, wie autonom die AI agiert, brauchst du unterschiedliche Sicherheits- und Überwachungsstrategien.

Modus 1: Automation – „AI macht"

Was ist das?

Du gibst eine konkrete Aufgabe ab, die AI erledigt sie weitestgehend selbstständig, du erhältst ein fertiges Ergebnis.

Typische Use Cases:

PDF-Zusammenfassungen erstellen

Research-Reports generieren

E-Mails formulieren

Daten strukturieren und aufbereiten

Texte übersetzen

Sicherheitsebene: Mittel

Die AI arbeitet autonom, aber du bekommst ein Endergebnis, das du überprüfen kannst, bevor es weitergeht.

Beispiel aus der Praxis:

Du hast ein 50-seitiges Whitepaper und brauchst eine 2-Seiten-Zusammenfassung für dein Team. Du lädst das PDF zu Claude hoch, gibst klare Anweisungen für die Zusammenfassung – und 30 Sekunden später hast du dein Ergebnis.

Effizienzgewinn: 90%. Risiko: Du musst den Output verifizieren, weil die AI möglicherweise wichtige Details falsch interpretiert hat.

Modus 2: Augmentation – „AI und ich gemeinsam"

Was ist das?

Ein iterativer Prozess, bei dem du und die AI gemeinsam an einer Lösung arbeiten. Du gibst Feedback, die AI optimiert, du verfeinerst weiter.

Typische Use Cases:

Brainstorming und Ideenentwicklung

Content-Creation (Blog-Posts, Präsentationen)

Strategieentwicklung

Code-Entwicklung mit mehreren Iterationen

Komplexe Analysen mit menschlicher Interpretation

Sicherheitsebene: Niedrig bis mittel

Du bist kontinuierlich im Loop, kannst direkt korrigieren und leitest den Prozess.

Beispiel aus der Praxis:

Du entwickelst eine neue Marketingstrategie. Die AI schlägt erste Ansätze vor, du gibst Feedback zu deiner Zielgruppe, die AI verfeinert, du hinterfragst einzelne Punkte, die AI liefert Alternativen.

Nach 20 Minuten gemeinsamer Arbeit habt ihr eine Strategie, die du allein in Stunden nicht hinbekommen hättest.

Pro-Tipp: Augmentation ist der Modus mit der höchsten Qualität – aber auch dem höchsten Zeitaufwand. Nutze ihn für wirklich wichtige, komplexe Projekte.

Modus 3: Agency – „AI entscheidet und handelt"

Was ist das?

Die AI arbeitet vollständig autonom, trifft Entscheidungen und führt Aktionen in deinem Namen aus – ohne dass du vorher jeden Schritt abnicken musst.

Typische Use Cases:

Automatisierte E-Mail-Beantwortung

Kalender-Management und Terminbuchungen

Automatisierte Workflows (z.B. via n8n, Zapier)

Autonome Browser-Agents

Selbstständige Datenverarbeitung und -weiterleitung

Sicherheitsebene: HOCH

Die AI agiert in deinem Namen. Fehler können direkte Auswirkungen haben (falsche E-Mails, fehlerhafte Buchungen, Datenlecks).

Beispiel aus der Praxis:

Du setzt einen E-Mail-Agent auf, der automatisch Support-Anfragen beantwortet. Er hat Zugriff auf deine Wissensdatenbank, kann Tickets erstellen und Kunden informieren. Klingt genial – aber was, wenn er vertrauliche Infos an die falsche Person sendet? Oder eine Preisauskunft gibt, die nicht mehr aktuell ist?

Reality Check:

Agency ist das Zukunftsversprechen – aber aktuell noch nicht ausgereift genug für kritische Business-Prozesse. Die Fehlerquote ist zu hoch, die Kontrollmechanismen zu schwach.

Warum diese Unterscheidung wichtig ist

Viele Unternehmen behandeln alle drei Modi gleich. Das ist ein Fehler. Je autonomer die AI arbeitet, desto strenger müssen deine Sicherheitsvorkehrungen sein.

Bei Automation überprüfst du den Output vor Verwendung. Bei Augmentation bist du im Loop. Bei Agency musst du vor dem Einsatz sicherstellen, dass die AI nur in definierten Grenzen agieren kann – und du brauchst Monitoring.

Das 4V-Framework hilft dir dabei, für jeden Modus die richtigen Entscheidungen zu treffen.

Teil 2: Das 4V-Framework – dein mentales Modell für sichere AI-Nutzung

🔒 Zugang nur für AInauten Premium Mitglieder

Werde jetzt VIP und hol dir AInauten Premium. Egal ob als Abo für kleines Geld und jederzeit kündbar, oder im Paket mit unseren anderen Kursen. Du wirst es lieben.

👉 Pakete anschauen 》⭐️ Mitglieder erhalten unter anderem ⭐️:

- Wöchentlich neue Tutorials & Praxis-Videos

- Zugang zu Premium Posts & Videos

- Regelmäßige Live Workshops mit Q&A für Mitglieder

- Premium Deep Dive Analysen

- Monatliches Executive Summary

- Optional: Zugang zu allen unseren Trainings (auch zukünftige)