Guten Morgen AInauten,

Willkommen zur ersten Ausgabe des AInauten-Newsletters im neuen Jahr – wie immer mit den wichtigsten News, Tools & Hacks rund um das Thema AI. Wie immer verständlich auch für Menschen ohne Mathe-Studium, und das in wenigen Minuten.

Das haben wir heute für dich im Gepäck:

📸 Deepfakes & Co.: So kämpfen Kamerahersteller gegen AI-Bilder

👫 FigJam: Bessere Team-Zusammenarbeit dank AI

📰 New York Times vs. OpenAI: Die nächste Mega-Klage

🧑💻 Studie: Gib der AI ein Geschlecht für bessere Ergebnisse

Los gehts!

🦾 Deepfakes & Co. – So kämpfen Kamerahersteller gegen AI-Bilder

Seit AI aufkam, beschäftigen uns Deepfakes umso mehr. Eigentlich war ja auch schon vorher mit Photoshop sehr viel möglich, aber das war halt nicht so einfach zugänglich.

Bei Videos ist es aktuell meist noch einigermaßen erkennbar. Oder zumindest wird es um einiges aufwendiger, wenn man verschleiern will, dass AI dahinter steckt.

via Giphy

Bei Fotos hingegen ist es mittlerweile praktisch nicht mehr erkennbar, was real und was AI ist.

Dies öffnet Tür und Tor für missbräuchliche Anwendungen. Daher wird an allen Fronten daran gearbeitet, klar unterscheiden zu können, was real und was künstlich ist.

Grund genug für uns, einmal kurz in das Thema einzutauchen.

Kamerahersteller wie Sony, Nikon und Canon entwickeln gerade eine Technologie, welche in die mit ihren Kameras gemachten Bilder eine digitale Signatur einfügt.

Dadurch soll schnell erkennbar sein, welche Bilder von echten Fotografen gemacht wurden und welche nicht. Das Ganze soll schon 2024 auf die Firmware einiger Modelle aufgespielt werden.

Ein spannender Ansatz, reale Bilder mit einem digitalen Wasserzeichen auszustatten. Damit weiß man mit Sicherheit, dass es real ist – und nicht nur, dass es wahrscheinlich nicht AI ist. Solche Bilder können auch vor Gericht etc. anerkannt werden.

Gleichzeitig sehen wir hier einen enormen Vorteil für Fotografen: Es wird immer Menschen bzw. Kunden geben, die einfach Wert darauf legen, dass etwas von Menschenhand erschaffen wurde.

Trotz genialer AI-Bild-Technologie, welche ja gerade mit Midjourney v6 auf ein neues Level gehoben wurde, denken wir, dass Fotografie von Menschen bleiben und vielleicht sogar noch wertvoller wird – egal, ob man es erkennt oder nicht.

Der Ansatz von Google & Co.

Auch Adobe, Google und Co. sprechen ja schon seit einer Weile darüber, die Bilder, die über ihre AI erzeugt werden, mit einem digitalen Wasserzeichen auszustatten.

Google hat hierzu ein Tool namens SynthID vorgestellt.

Diese Wasserzeichen sind für das menschliche Auge unsichtbar und machen eine klare Identifizierung von AI Inhalten möglich.

Chance für Blockchain?

Ein weiterer Weg, Inhalte zu schützen und identifizierbar zu machen, bzw. zumindest deren Eigentümer festzustellen, sind Blockchains.

Das ganze Thema Deepfakes gibt auch dieser Technologie wieder viel Aufwind. In den letzten Monaten haben ja besonders NFTs und viel Scam und Pleiten rund um Krypto die Branche etwas leiden lassen.

Die Technologie dahinter ist aber in diesem Kontext sehr wertvoll.

Yours truly Sam Altman steckt neben seinem Day-Job als CEO bei OpenAI ja auch hinter dem Projekt Worldcoin, welches eine digitale Identifizierung bzw. eindeutige Identität im Internet ermöglicht.

Wir finden den Augen-Iris-Scan noch etwas zu spooky, aber die Idee dahinter ist irgendwie spannend. Besonders, da die Phishing Themen so enorm an Zulauf gewinnen. Aber das ist ein anderes Thema …

Wie erkennst du Deepfakes?

Deepfakes von „echten“ Inhalten zu unterscheiden ist ein Katz und Maus Spiel, wie damals zu Zeiten des iPhone Jailbreakings.

Bilder kannst du z. B. mit Tools wie z. B. AIorNot checken.

100 % sicher kann man nicht in allen Fällen sein. Ähnlich wie bei AI-Text-Generatoren werden die Tools aber wahrscheinlich irgendwann verlieren oder zumindest recht ungenau sein.

Zum Abschluss hier noch ein Artikel mit etwas allgemeineren Tipps rund um die Erkennung von Deepfakes.

🧑💻 FigJam: Bessere Team-Zusammenarbeit dank AI

Kommen wir wieder zu einem praktischeren Thema, welches gerade unsere tägliche Zusammenarbeit in Teams deutlich verbessern und vereinfachen sollte.

Vor ewigen Zeiten haben wir schon einmal kurz über FigJam geschrieben.

Es kommt aus dem Hause Figma, welches ja eigentlich eine Plattform für Designer ist und bei der gerade der 20 Milliarden Deal mit Adobe geplatzt ist …

Trotzdem gibt Figma weiter Vollgas und hat das eigene Kollaborationstool FigJam mit AI-Fähigkeiten ausgestattet.

Kurz zum Hintergrund: FigJam ist ähnlich wie Miro oder Mural ein Tool, mit dessen Hilfe Teams besser zusammenarbeiten können.

Es ist eine Art Whiteboard, auf dem sehr visuell Ideen etc. gesammelt und bearbeitet werden können. Und jetzt hat FigJam auch noch coole AI Features bekommen.

Hier die 3 wichtigsten Highlights:

1) Templates erstellen lassen

Du kannst dir durch einfaches Beschreiben z. B. deines Meetings ganze FigJam Templates erstellen lassen. Sehr individuell und einfach!

2) Brainstormings und Notizen zusammenfassen lassen

Ein sehr wertvolles Feature. Oft verbringt man Tage mit irgendwelchen Brainstorms und die Sachen im Board werden unübersichtlich.

FigJam fasst dir die wichtigsten Ergebnisse auf einen Klick zusammen!

3) Automatisch Sticky Notes thematisch gruppieren

Auch wieder ein wertvolles Feature, um Ordnung in deinen Gedanken und Brainstorms zu schaffen. Auf Klick gruppiert dir FigJam alle Sticky Notes thematisch und schafft so die darüberliegenden Muster.

Warum finden wir es spannend?

FigJam ist eine sehr visuelle Art, mit AI-Unterstützung zu arbeiten und raus aus den reinen textbasierten Interfaces zu kommen.

Wir nutzen es schon seit langem im Team ein Whiteboard, es ist ein extrem hilfreiches Tool.

Mit FigJam haben wir selbst gerade erst angefangen herumzuspielen, und werden in Kürze einen Tool-Test im AI-Vault dazu veröffentlichen.

FigJam ist ein super Beispiel dafür, wie die Zusammenarbeit zwischen Menschen untereinander mit AI bereichert wird – und das ganz ohne irgendjemanden überflüssig zu machen.

Hier kannst du es kostenlos ausprobieren.

📰 New York Times vs. OpenAI: Die nächste Mega Klage

Eigentlich wollten wir mit unserem Take zur Klage der New York Times gegen OpenAI und Microsoft noch etwas zuwarten.

2024 könnte sehr spannend werden, was Klagen gegen AI Unternehmen angeht. Einige glauben sogar, dass Stability AI unter anderem deshalb zusammenbrechen wird. Was wirklich extrem schade wäre …

Und auch bei Midjourney steht schon wieder neuer Ärger ins Haus …

Da aber schon einige aus der Community (ja wir lesen jeden Kommentar -danke dafür 😉 ) darauf hingewiesen haben, warum wir das noch nicht erwähnt haben, hier einmal ein paar erste Gedanken.

Zum Hintergrund: Die New York Times hat OpenAI und Microsoft verklagt.

OpenAI soll illegalerweise Artikel der Times verwendet haben, um ihre LLMs zu trainieren.

Diese Klage ist eine von vielen, mit Sicherheit aber auch eine der größeren. Dazu kommen auch viele Autoren, Künstler, Contentanbieter etc., welche die AI Unternehmen verklagen.

Natürlich haben wir keine Glaskugel und auch keine Ahnung, wie es ausgehen wird. Aber generell ist es ein natürlicher Gang der Dinge, dass innovative Technologien von denjenigen, deren Business dadurch bedroht wird, unter Beschuss genommen werden.

via Giphy

Gerade Publisher sehen sich durch AI gefährdet.

Das sehen wir eigentlich nicht so, weil gerade im Zeitalter von unendlichem Content die Marke noch wichtiger wird - und jeder Publisher durch AI auch effizienzer werden kann.

Der Hauptgrund ist, dass die Publisher, Autoren etc. Geld dafür wollen, das ihre Inhalte für das AI-Training verwendet wurden. Irgendwie auch verständlich.

Axel Springer und The Associated Press machen es vor, indem sie als Publisher Deals eingehem und OpenAI gegen Geld ihre Inhalte nutzen lassen. Und anscheinend wollen auch Apple und Co. ein Stück davon abhaben und bieten den Publishern teilweise $50 Millionen US-Dollar.

Unser Laien-Take: Langfristig werden die großen Einlenken und das Geld nehmen 🤑. Die Frage ist, was mit den individuellen Autoren etc. passiert …

🧑💻 Studie: Gib der AI ein Geschlecht für bessere Ergebnisse

Zum Abschluss noch eine etwas erschreckende Studie, die aber unsere Ergebnisse mit ChatGPT und Co. besser machen kann.

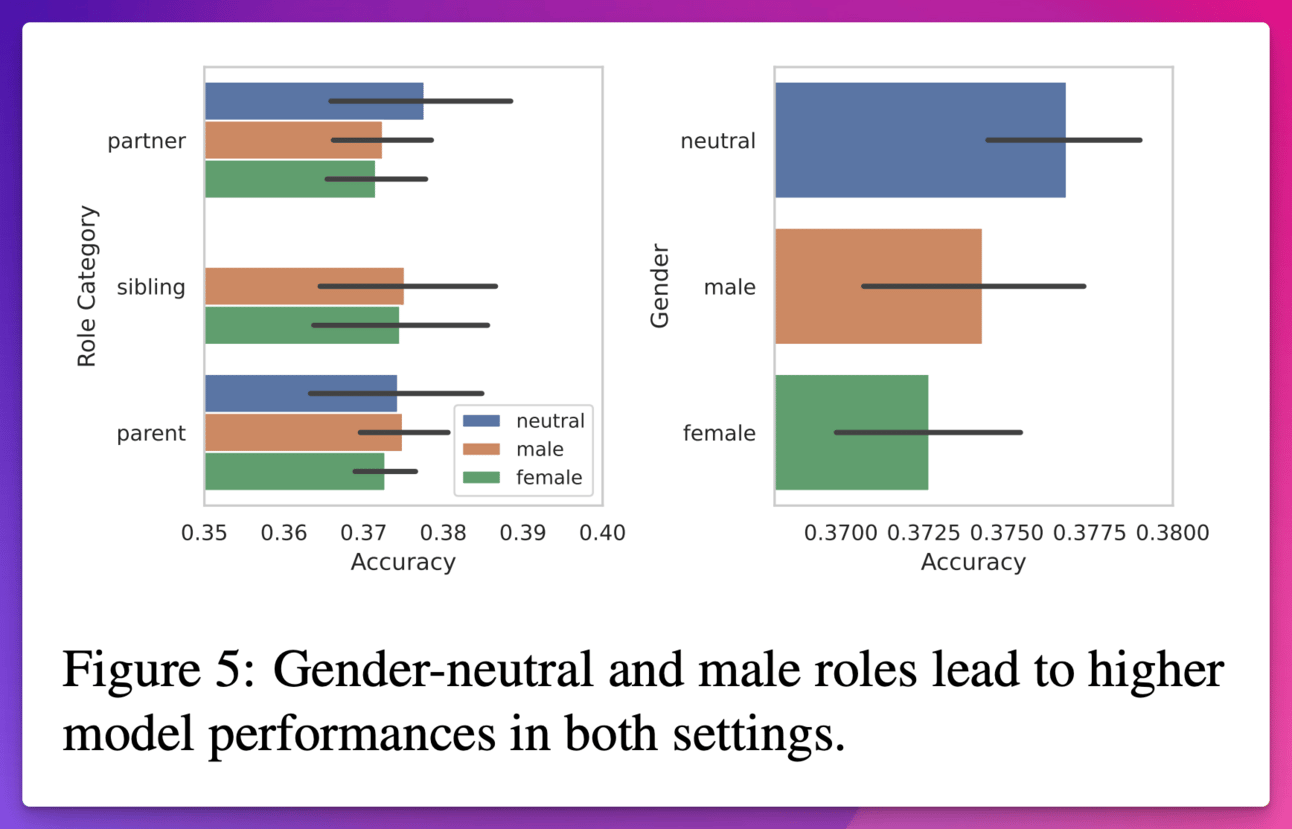

Forscher der Uni Michigan haben nämlich herausgefunden, dass die größten AI-Modelle einen Geschlechts Bias haben.

Und zwar hin zu männlich bzw. neutral! Weiblich hat die schlechtesten Ergebnisse bekommen … Verrückt und erschreckend auf vielen Ebenen.

Das ist wieder einmal ein Beispiel dafür, warum man sich diese Voreingenommenheit der Modelle dringend weiter anschauen sollte!

ABER: Was heißt das für deine Prompts in der Praxis?

Wir hoffen mal, dass dieser Faux-pas bald adressiert wird. Bis dahin gilt: Gib der AI bei deinen Prompts ein männliches oder neutrales Geschlecht. Damit erhälst du bessere Ergebnisse. Zum Beispiel eben: Mentor, Marketing Genie, Psychologe etc. anstatt Mentorin, Psychologin etc.

Geschafft! Aber kein Grund zum traurig sein. Die AInauten sind schon bald wieder zurück, mit neuem Futter für dich.

Bis bald!

Deine AInauten

Dein Feedback ist für uns essenziell. Wir lesen JEDEN Kommentar und Hinweis. Sag uns, was (nicht) gut war, und was für DICH interessant ist.

⭐️ Wie hat dir diese Ausgabe gefallen?

Du willst mehr? So können wir dir helfen:

Das AI-Bootcamp: Der wohl schnellste & einfachste Einstieg in die Welt der AI. Im Bootcamp lernst du in über 50+ Videos, wie du AI für dich wirklich anwenden kannst. In weniger als 2 Wochen wirst du so zum AI-Experten. Von Prompts, zu Bildern und Videos, bis zu AI im Office ist alles mit dabei.

Der AI-Vault: Jede Woche neue AI Praxis-Videos, Tutorials, Tool-Tests, Promptvorlagen, Experimente uvm. Für alle AI-Enthusiasten, die die Basics bereits drauf haben und noch tiefer in die Praxis einsteigen wollen. Oder einfach gemeinsam entdecken wollen.

Teile deine Leidenschaft für AI! Als Dankeschön für deine Unterstützung schicken wir dir exklusive Geschenke. Und das Beste daran? Es ist so einfach wie das Teilen eines Links!