Moin AInauten,

Willkommen zur neuen Ausgabe deines Lieblingsnewsletters! Heute etwas OpenAI-lastig. Aber wir haben auch etwas zu AI-Video-Praxis im Gepäck:

🤔 Liest und speichert OpenAI alles?

🎥 Konsistente AI-Videos, z. B. mit Google Veo-3

🤑 OpenAI launched o3-Pro und wird deutlich günstiger

Los geht’s!

🤔 OpenAI liest alles mit und speichert es?

Heute starten wir einmal mit einem etwas philosophischeren Thema, was uns gerade beschäftigt.

OpenAI wehrt sich dagegen, alle Chats speichern zu müssen.

Der Hintergrund: Ein US-Gericht zwingt OpenAI dazu, ALLE Chats zu speichern - selbst wenn du sie manuell löschst!

Warum? Weil die New York Times wegen Copyright-Verletzungen klagt und verhindern will, dass damit „Beweise“ gelöscht werden. Die Folgen davon betreffen nun hunderte Millionen ChatGPT-Nutzer!

Irgendwie ist uns ja klar, dass OpenAI “mitliest”. Allerdings fühlt es sich nicht gut an, wenn alle Chats gespeichert werden.

Wichtiger Hinweis: Enterprise & API-Kunden sind vom Gericht ausgenommen. Wer ChatGPT also im Unternehmenskontext oder über die Schnittstelle nutzt, sollte fein sein.

Es gibt aber auch eine positive Seite des Mitlesens!

OpenAI hat gerade ihren neuesten Threat Intelligence Report veröffentlicht. Und der liest sich wie ein Agentenfilm…

Was in den letzten 3 Monaten passiert ist:

Es wurden 10 verschiedene bösartige Cyber-Operationen entdeckt und gestoppt.

Die Angreifer kommen aus China, Russland, Iran, Kambodscha und den Philippinen.

Von Fake-Job-Schemes über Desinformations-Kampagnen bis hin zu Malware-Entwicklung ist alles dabei.

Ein russischer Hacker nutzte ChatGPT sogar für Windows-Malware-Debugging 😲!

Das Verrückte: Diese Threat Actors werden immer professioneller. Ein chinesisches Netzwerk generierte mit ChatGPT hunderte Kommentare für einen einzigen TikTok-Post, um damit fake Engagement zu simulieren. Ein anderes Netzwerk aus Kambodscha verschickte SMS an zufällige UK-Nummern und versprach £360-500 täglich für das Liken von Social Media Posts.

In solchen Fällen ist es also schon ganz gut, dass OpenAI mitliest und da einschreitet, um Schlimmeres zu verhindern.

Unser Take: Das ist die Zerreißprobe für AI-Vertrauen!

Einerseits schützt uns die Überwachung ein Stück weit vor Cyberkriminellen.

Andererseits gibt es ja bereits unzählige OpenSource-Modelle, die in dieser Form nicht überwachbar sind.

Ohne etwas verheimlichen zu wollen, finden wir es so semi, wenn Gerichte alles einsehen können…

Sam Altman schlägt jetzt "AI Privilege" vor - so etwas ähnliches wie das Arzt-Patienten-Geheimnis.

Ganz ehrlich: Der Mann hat einen Punkt. Wenn AI unser digitaler Therapeut, Berater und Kreativ-Partner, vielleicht auch Arzt ist, sollte das vertraulich sein …

Wer nach Alternativen zu ChatGPT sucht, die lokal, in der eigenen Cloud oder zumindest über API funktionieren: hier haben wir vor einiger Zeit einen Premium Deep-Dive als Überblick dazu geschrieben.

🎥 Konsistente AI-Videos, z. B. mit Google Veo-3

Das aktuell wohl beste AI-Video-Modell, Google Veo-3, ist seit letzter Woche endlich auch per API verfügbar und in Tools wie z. B. Krea oder auch Replicate verfügbar.

Wir hatten es am Freitag schon zum Thema in unserer AI + Automation Community. Allerdings waren da vor allem die Replicate Server noch überlastet, so dass es ewig gedauert hat, ein Video zu bekommen.

Jetzt geht es flotter, daher schreiben wir auch hier darüber. Auf Replicate kannst du das ganze ohne Abo schnell ausprobieren.

Aber Achtung: AI-Videos sind teuer. Aktuell kostet dich ein 8 Sekunden Video ca. 5 Euro.

So kannst du konsistente, längere Videos erstellen

Das große Problem bei AI-Videos ist, dass die Clips meistens nur 5–10 Sekunden lang sind.

Will man längere Videos machen, muss man mehrere Videos erstellen und aneinander hängen.

Der Knackpunkt dabei ist, dass es sehr schwer ist, Charaktere und Szenen über mehrere Videos konsistent zu halten.

Vorab: Final gelöst haben wir es noch nicht - aber immerhin zwei Wege gefunden, die man für konsistentere Resultate ausprobieren kann.

1) Seed verwenden

Bei Replicate hast du z. B. die Möglichkeit, die Seed ID eines Videos für die Erzeugung des nächsten zu verwenden.

Wie du aber am Bild oben im Vergleich mit dem GIF noch weiter oben siehst, sind die Szenen zwar ähnlich, aber weder das Studio, noch die Moderatorin ist exakt gleich.

Aber immerhin sehr ähnlich …

2) Detaillierte, konsistente Prompts

Eine zweite Methode, die für uns aktuell ganz gut funktioniert, sind extrem detaillierte Prompts mit exakten Beschreibungen zu verwenden, und diese Beschreibungen über die verschiedenen Szenen hinweg konsistent zu halten.

Ziemlich aufwändig, aber zum Glück hilft uns die AI dabei. Hier ein Beispielprompt, der für dich verschiedenen Szenen in detaillierte und konsistente Prompts verwandelt:

{hier deine Liste mit Szenen eintragen}

Oben siehst du die Liste der Szenen, die wir für mein KI-generiertes Video brauchen. Wir nutzen dafür Google Veo 3, das sowohl Video- als auch Audioausgabe unterstützt.

ABER: Veo 3 hat klare Einschränkungen:

Jedes Video darf maximal 8 Sekunden lang sein (du musst also entsprechend prompten).

Jede Szene wird isoliert generiert – das heißt, Veo 3 hat keine Ahnung, wie die letzte Szene aussah, wie die Charaktere aussahen oder was im vorherigen Clip passiert ist.

Deshalb musst du jedes einzelne Detail EXAKT beschreiben. Du darfst nichts dem Zufall überlassen. Beschreibe Aussehen, Kleidung, Umgebung, Stimmung, Kamerawinkel – alles. Wiederhole diese Beschreibungen von Szene zu Szene, damit Stil und Kontinuität erhalten bleiben.

Deine Aufgabe: Schreibe eine Serie von Prompts, die ich Veo 3 geben kann, um jeweils einen 8-Sekunden-Clip zu generieren. Ich werde die Clips später zusammenschneiden, um ein konsistentes längeres Video zu haben.

WICHTIG:

- Keine Mehrdeutigkeit.

- Keine offenen Interpretationen.

- Jeder Prompt muss komplett eigenständig sein.

Vorgehen:

Zuerst denkst du mindestens 25 Absätze lang im Tag <thinking> über die Umsetzung nach.

Dann gibst du die fertigen Prompts in nummerierter Reihenfolge im Tag <prompts> aus.Prompt Tipps von Google

Falls du noch gar nicht mit Google Veo-3 oder AI-Video experimentiert hast, hier kurz ein paar wichtig Prompting-Begriffe, die Google als Tipps veröffentlicht hat:

Bildkomposition: „Nahaufnahme“, „Zweier-Einstellung“, „Über-die-Schulter-Einstellung“, …

Objektiv & Fokus: „Makroobjektiv“, „geringe Schärfentiefe“, „Weitwinkelobjektiv“, …

Genre & Stil: „Science-Fiction“, „Romantische Komödie“, „Actionfilm“, …

Kamerabewegung: „Zoom“, „Dolly-Shot (Kamerafahrt)“, „Tracking-Shot (Mitführung)“, „Schwenk“, …

Beispiel-Prompt:

Nahaufnahme (Komposition) von schmelzenden Eiszapfen (Motiv) an einer gefrorenen Felswand (Kontext) mit kühlen Blautönen (Stimmung), herangezoomt (Kamerabewegung), wobei die Details der herabtropfenden Wassertropfen (Aktion) erhalten bleiben.

⚠️ HINWEIS: Englische Prompts klappen besser als Deutsche.

🤑 OpenAI launched o3-Pro und wird deutlich günstiger

Zum Abschluss noch eine kurze News, die für weitere Verwirrung in OpenAI’s Model-Wahnsinn sorgt: soeben hat OpenAI ihr bisher schlaustes Reasoning Model vorgestellt: o3-Pro!

Wir sehen es schon im OpenAI Playground und es soll auch bald in ChatGPT ausgerollt werden. Wie immer ist das Modell noch schlauer, noch besser und hat gefühlt alle lebenden Menschen schon überholt.

Das Ding „denkt länger“ als andere Models und liefert dabei krass zuverlässige Ergebnisse.

ABER: Bevor du jetzt loslegst und nur noch mit o3-Pro chatten willst, sei gewarnt.

Es ist langsam. Es ist unglaublich langsam. Und teuer. Ben Hylak von Raindrop warnt: Ein simples "Hi" kann $80 kosten und 20 Minuten dauern. 😲

Dafür gibt es auch eine gute Nachricht für das reguläre o3 Modell - da wird nämlich knapp 80 % billiger, von $10/$40 auf $2/$8 pro Million Tokens (87 % günstiger als das alte o1-pro!). Das o3-Pro schlägt mit $20/$80 zu Buche.

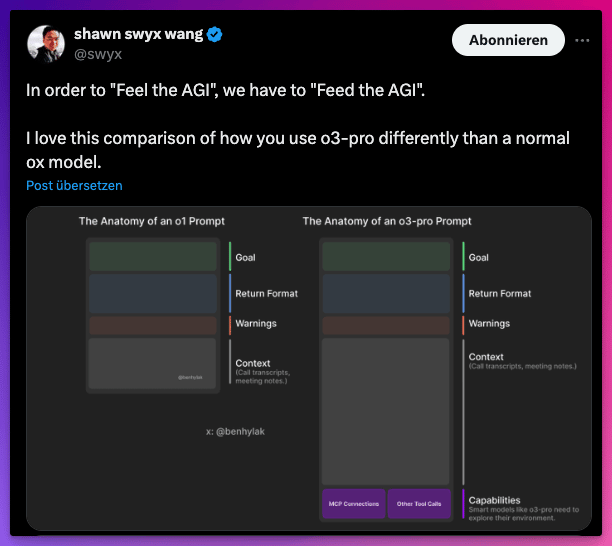

Wann und wie solltest du o3-Pro nutzen?

Wie schon gesagt: das neue Modell ist teuer und langsam. Aber unendlich smart, und damit für deine komplexesten Herausforderungen eine gute Wahl. Auch super ist, dass es mit allen Tools und MCP-Connections umgehen kann.

Verschwende aber nie kurze Prompts ans o3-Pro-Modell! Geh stattdessen richtig in die Tiefe und packe unendlich viel Kontext in deinen Prompt. Dann wird auch das Resultat richtig gut!

Wir finden folgende Gegenüberstellung einer Prompt-Anatomie für o3-Pro sehr gut. Der Unterschied von o1 zu o3-Pro ist, dass es sehr viel mehr Kontext verträgt und Tool-Access hat. Viel Spaß beim Ausprobieren!

So, ist wieder etwas lange geworden heute. Deshalb ein ganz besonderes Danke an dich, falls du bis hierher gelesen bist. Bis am Samstag!

Reto & Fabian von den AInauten

Wann immer du bereit bist, so können wir dir helfen:

👨🚀 AINAUTEN CRASHKURS + WÖCHENTLICHE UPDATES: Der wohl schnellste und einfachste Einstieg in die Welt der AI. Im Crashkurs lernst du schnell, wie du AI für dich wirklich anwenden kannst. In weniger als zwei Wochen wirst du damit zum AI-Experten. Von Prompts, zu Bildern und Videos, bis zu AI im Office ist alles mit dabei. Und mit AInauten Premium erhältst du jede Woche neue wichtige Deep-Dives. Klicke hier!

🔥 AI + AUTOMATION: Erlerne die wohl wichtigste Fähigkeit für die nächsten Jahre und kombiniere KI mit Automatisierungen. Automatisiere dich selbst, dein Team oder biete es als Service für Unternehmen an. Dieses Wissen ist aktuell extrem gefragt. Unser Accelerator bringt dich von 0 auf 100. Keine Programmierkenntnisse nötig. Klicke hier!